Deutschland soll zur KI-Nation werden, so der Koalitionsvertrag. Was das genau bedeutet, bleibt unklar. Klar ist jedoch, dass die Regeln für ChatGPT & Co uns alle betreffen, sei es in der Schule oder bei der Beantragung eines Reisepasses.

Das KI-Gesetz der EU soll eigentlich weitreichende Regeln schaffen. Doch von Anfang an standen die Verhandlungen unter starkem Lobbydruck und wurden von Big Tech und europäischen KI-Start-ups verwässert. Bereits vor einem Jahr deckten wir dies mit europäischen Partnern auf.

Wie jedoch die Regeln für Allzweck-KI-Modelle aussehen, war bisher offen. Dabei handelt es sich um KI-Systeme, die für verschiedene Zwecke eingesetzt werden können,etwa für Recherche, Text- oder Bilderbearbeitung. Am bekanntesten ist das mit Microsoft verbundene ChatGPT. Aber auch von Google und Meta gibt es eigene Allzweck-KI-Modelle.

Für diese KI-Systeme gelten besondere Regeln, die die EU Anfang Mai in einem Verhaltenskodex (Code of Practice) veröffentlichen will. Derzeit zeichnet sich jedoch bereits eine Verzögerung ab.

Gemeinsam mit unserer Partnerorganisation Corporate Europe Observatory (CEO) haben wir recherchiert, wie groß der Einfluss der Tech-Lobby auf diese Regeln ist. Unser Ergebnis:

- Der Prozess war von Beginn an einseitig.

- Tech-Konzerne hatten mehr Mitspracherecht als die Zivilgesellschaft.

- Es wurden Beratungsfirmen beauftragt, die Interessenkonflikte haben.

Diese Nähe zu Big Tech spiegelt sich auch im Ergebnis wider: Der aktuelle Entwurf trägt deutlich die Handschrift von Microsoft, Google & Co. Die Risikobewertung von Allzweck-KI-Modellen wurde deutlich abgeschwächt.

Für uns ist jedoch klar: Statt Deregulierung zu fördern, sollte die EU-Kommission entschieden gegen die Agenda der Tech-Monopole vorgehen und die Regulierung von KI stärken.

Privilegierter Zugang von Big Tech

Die Regeln für ChatGPT & Co werden in einem Verhaltenskodex festgelegt. An der Erarbeitung waren über 400 Organisationen beteiligt. Doch von einem ausgewogenen Prozess konnte keine Rede sein: Tech-Konzerne wie Google, Microsoft, Meta, Apple und Amazon hatten weit mehr Zugang als andere Interessengruppen. Mehrere große KI-Modellanbieter, die der Kodex regulieren soll, wurden zu speziellen Workshops eingeladen. Darunter 15 Konzerne aus den USA.

Andere Beteiligte, einschließlich zivilgesellschaftlicher Organisationen und kleiner Unternehmen, hatten nur begrenzten Zugang zum Prozess. Ihre Teilnahme beschränkte sich zumeist auf eine Emoji basierte Bewertung von Fragen und Kommentaren über eine Online-Plattform.

Mehrere Beteiligte, darunter die NGO Reporter ohne Grenzen, zogen sich aufgrund des einseitigen Einflusses von Big Tech zurück.

Interessenkonflikte

Das AI-Office der EU-Kommission beauftragte externe Beraterfirmen mit der Ausarbeitung des Verhaltenskodex. Unsere Recherche zeigt, dass die Beraterfirmen geschäftliche Verbindungen zu Big Tech haben. Ein Beispiel: Der Hauptauftragnehmer, das französische Beratungsunternehmen Wavestone, implementiert das KI-Tool 365 Copilot von Microsoft in französischen Unternehmen – und zwar im Auftrag von Microsoft. 2024 wurde Wavestone mit dem „Microsoft Partner of the Year Award“ ausgezeichnet, während die Beraterfirma gleichzeitig bereits die EU-Kommission bei der Entwicklung des Verhaltenskodex unterstützte.

Auch das italienische Beratungsunternehmen Intellera und das Centre for European Policy Studies (CEPS) haben Verbindungen zu Anbietern von Allzweck-KI-Modellen.

Wir haben die EU um eine Stellungnahme gebeten, aber bis zur Veröffentlichung der Recherche keine Antwort bekommen. Auch die drei externen Beraterfirmen haben wir kontaktiert: Wavestone hat keine Fragen zu Interessenkonflikten beantwortet. Intellera und CEPS haben gar nicht geantwortet.

Diskriminierung als weniger riskant eingestuft

Eines der umstrittensten Themen ist die Risikotaxonomie. Diese legt fest, welche Risiken die Anbieter prüfen und mindern müssen. Der zweite Entwurf des Kodex unterscheidet nur noch zwischen weitreichenden „systemischen Risiken“, wie dem Verlust menschlicher Aufsicht, und einer viel schwächeren Kategorie zusätzlicher zu berücksichtigender Risiken. Wobei letztere deutlich schwächer definiert sind.

Die Pflichten für die Betreiber von Allzweck-KI-Modellen unterscheiden sich deutlich: Die Anbieter müssen systemische Risiken erkennen und mindern, aber die zweite Stufe, die auch Risiken für Grundrechte, Demokratie oder die Umwelt umfasst, ist für die Anbieter optional.

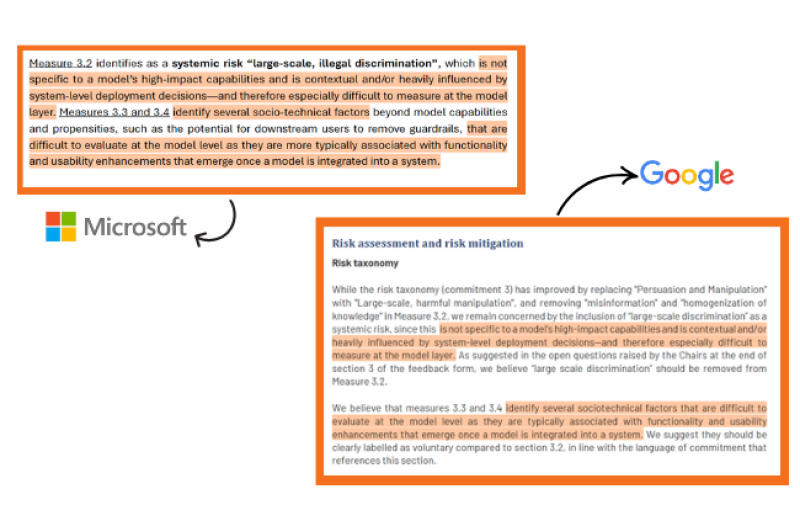

Die Recherche zeigt die konzertierte Lobbyarbeit von Google und Microsoft. Die Konzerne bewirkten, dass Diskriminierung durch KI aus der Liste der systemischen Risiken gestrichen und die Risikoabschätzung somit geschwächt wurde.

Interessanterweise haben sie das mit genau dem gleichen Wortlaut gemacht. Das zeigt, dass Google und Microsoft, die sich oft als Konkurrenten sehen, ihre Positionen zu den kleinsten Details des Kodex abgestimmt haben.

Bessere Regeln nötig

Der einseitige Prozess zur Entwicklung des KI-Verhaltenskodex hat den Tech-Konzernen einen privilegierten Zugang verschafft, über den die Zivilgesellschaft nicht verfügt. Das ist inakzeptabel und stärkt die Macht von Google, Meta, Microsoft & Co. Big Tech hat aufgrund seiner enormen Ressourcen bereits ohnehin erheblichen Einfluss auf die EU-Politik.

Es ist keine Überraschung, dass der privilegierte Zugang der KI-Industrie zu einer Verwässerung der KI-Regeln geführt hat. Aber wir brauchen bessere statt schwächere Regeln. Die EU muss daher nachbessern, die Regulierung von KI stärken und entschieden gegen die Agenda der Tech-Monopole vorgehen.

Bleiben Sie informiert über die Macht der Digitalkonzerne

Abonnieren Sie unseren kostenlosen Newsletter.

Datenschutzhinweis: Wir verarbeiten Daten auf der Grundlage der EU-Datenschutz-Grundverordnung (Art. 6 Abs. 1). Der Verwendung der Daten kann jederzeit widersprochen werden. Zur Datenschutzerklärung.

Weitere Informationen

- Die kompletten Rechercheergebnisse haben wir gemeinsam mit CEO auf Englisch veröffentlicht.

- Gemeinsam mit CEO und Observatoire des Multinationales haben wir bereits im März 2024 aufgedeckt, wie Big Tech und europäische Start-ups erfolgreich den AI Act verwässert haben.

- Hier unsere Pressemitteilung zur Studie